До чего дошли системы предсказания преступлений — и за что их критикуют

Не так давно в Чикаго полицейская система предиктивной аналитики посчитала, что Роберт Макдэниел вскоре станет участником перестрелки. За ним было установлено наблюдение: патрульные стали захаживать в магазинчик, где он работал, навещать Макдэниела дома. В конце концов преступление действительно произошло. На Роберта совершили покушение местные бандиты, которые сочли, что раз полицейские стали проявлять к нему такое внимание, но до сих пор не арестовали, то он работает на них. Мы не знаем наверняка, происходили ли события именно таким образом, ведь эта история стала известна журналистам исключительно со слов самого Макдэниела, но предиктивные системы аналитики уже прочно вошли в быт американских правоприменителей. Последовать примеру США хотят их коллеги и в других странах. Младший научный сотрудник Института проблем правоприменения при Европейском университете в Санкт-Петербурге Дмитрий Серебренников рассказывает, что известно об устройстве этих систем — и какие возражения есть у специалистов к правосудию из черного ящика.

История

Программы предсказания преступности (predictive policing или pre-policing) занимаются сбором и анализом данных о случившихся преступлениях для того, чтобы определить будущего преступника или предсказать место преступления. Предполагается, что это позволяет полицейским предотвращать возможные происшествия или вводить те или иные профилактические меры. В академической сфере подобные инструменты начали разрабатывать еще в первой половине ХХ века. Так, Эрнест Бёрджесс, один из основателей Чикагской школы социологии, в 1928 году разработал статистическую модель, предсказывающую вероятность рецидива после условно-досрочного освобождения заключенного из тюрьмы. Однако такие изыскания долгое время не переходили со страниц научных журналов в практическую плоскость.

Предотвращать правонарушения и даже обеспечивать «процветание» жизни горожан было центральной задачей европейской полиции еще в XVII веке, когда она только появлялась. Однако к ХХ веку, особенно в англоговорящих странах, этот принцип трансформировался в так называемую «реактивную стратегию полицейской работы», суть которой заключается в создании условий для скорейшей реакции на нарушения закона.

Запрос на анализ криминальной обстановки и, соответственно, предсказание преступлений, появился у полиции только к 1960-м годам. Он нашел выражение в создании карт концентрации преступности и все более тесном сотрудничестве правоприменителей с социальными учеными (в случае США и Англии). В 1990-е это сотрудничество резко усиливается благодаря доктрине New Public Management.

New Public Management — это подход к госуправлению, который предполагает перенос моделей управления частными корпорациями на государственный сектор и особое внимание к управлению на основе данных. Для более подробного знакомства с доктриной в целом предлагаем обратиться к этой статье или, если вас заинтересовали ее проявления в полицейской работе, к текстам о системе «контроля» преступности CompStat, также появившейся в это время.

Современные программы можно разделить на два типа, оба из которых пользуются популярностью у правоприменителей в США и Западной Европе:

- person-based — ориентированные на выявления человека, который вероятно совершит преступление;

- place-based — ориентированные на место, в котором возможно будет совершено преступление .

Число «персональных» инструментов очень велико. Это может быть и предсказание рецидивов после условно-досрочного освобождения, и анализ социальных сетей и открытых данных в поисках потенциальных правонарушителей, и вычисление сумм залога и размера наказания для осужденных, исходя из предсказанной для них вероятности повторно нарушить закон, и многое другое. Эти системы появились в результате того, что у полицейских скопилось достаточно большие объемы самых разных данных о гражданах — а после перевода документооборота на цифровые рельсы их стало можно собирать и анализировать.

Вокруг каждой из технологий ведется множество дискуссий, которые иногда друг с другом связаны лишь отдаленно. Однако общим местом в них становится непрозрачность работы алгоритмов, а также то, что они могут не соответствовать законам о персональных данных и представлениям граждан о границах личной приватности. Поэтому в некоторых странах (например, в Германии) использование таких алгоритмов ограничено.

Второй тип систем более универсален. Дебаты вокруг них сосредоточены на критике или поддержке одних и тех же технических решений. Кроме того, общие аргументы сторонников и противников во многом можно перенести и на person-based решения, именно поэтому ниже мы рассмотрим только place-based системы.

Их разработчики, конечно же, знакомы с идеями криминологическими теорий «разбитых окон», рутинных действий и ситуационного предупреждения преступности. Однако на уровне практической реализации в сервисах для полицейских используются модели из совсем другой науки, сейсмологии — которые изначально применялись для прогнозирования каскадных землетрясений. В этой логике, когда в каком-то месте происходит резкий рост определенных преступлений, можно ожидать, что он продолжится еще некоторое время, и полиции необходимо успеть отреагировать на него.

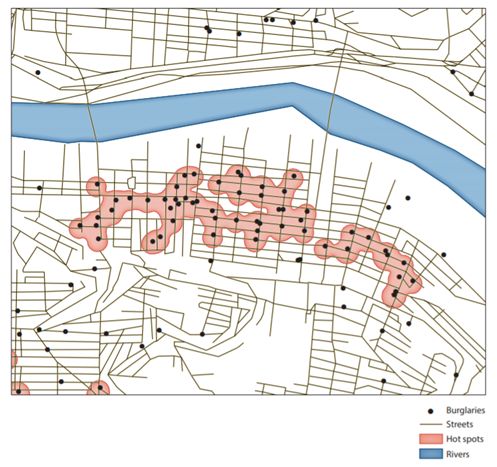

Таким образом, основной задачей полицейских становится контроль «горячих точек» (hotspots) — мест с непропорционально высокими количеством и интенсивностью определенных преступлений. Как утверждалось в одном из первых исследований по теме, преступность крайне неравномерно распределена по городу — настолько, что 50 процентов звонков в полицию поступают из 3 процентов городских локаций. Через анализ динамики таких «горячих точек» и измерялась эффективность инструментов прогнозирования преступности. Если алгоритм верно определил, что в каком-либо месте возникнет hotspot или наоборот, корректно определял безопасные районы, то технология считалась эффективной.

«Горячие точки» ограблений 2014 года в одном из районов Питтсбурга, Пенсильвания

Два гиганта

Сами программы прогнозирования места преступления развивались от гибких, но сложных для работы, к простым, но, подчас топорным в использовании — по аналогии с тем, как происходила эволюция дизайна интерфейсов смартфонов в последние два десятилетия. Это хорошо иллюстрирует история двух гигантов этого рынка — компаний PredPol и HunchLab.

HunchLab была создана в 2008 году и проектировалась, как многофункциональный помощник полицейского — и, как следствие, имела не очень дружелюбный (но очень тонко настраиваемый) интерфейс для пользователя. По задумке изобретателей, программа должна была помочь офицеру анализировать разные виды преступлений и задействовать для этого максимально широкий инструментарий. Например, технология HunchLab предоставляла карты предсказанных преступлений в зависимости от выбранной статистической модели и тонкой подстройки данных для анализа (например, текущего состояния преступности, погоды, социально-экономических показателей разных частей города и тому подобного).

Продажи первой версии HunchLab провалились: из 60 полицейских департаментов, которым предполагалось продать технологию, контракт заключили лишь с двумя.

Модель PredPol была построена на кардинально иных началах — создавалась она как система, которой были необходимы лишь данные о криминальных инцидентах. На их основе она выдавала полицейскому карту, на которой подсвечивала места, где вероятность совершения преступления ей казалась высока, а ему лишь было необходимо решить, как быстрее всего объехать все выделенные точки. И вот этот интерфейс пришелся правоприменителям по душе: выйдя на рынок в 2012 году, модель быстро распространилась по отделам полиции США.

Любопытно, что один из создателей PredPol, Джеффри Брэтингем (Jeffrey Brantingham) — профессор антропологии Калифорнийского университета в Лос-Анджелесе (UCLA). Он изучал адаптацию к окружающей среде охотников-собирателей в Северном Тибете и позже, по собственному признанию, применил знания, полученные в этом поле, к исследованию криминальных районов Лос-Анджелеса — так ли отличается охотник-собиратель, который пробирает через лес в поисках дичи, от «охотника», что ищет плохо закрытый автомобиль или небрежно брошенную сумку?

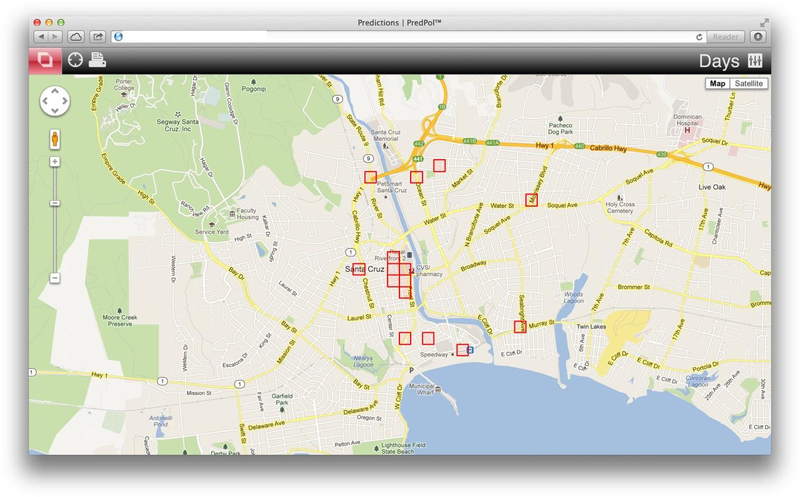

Скриншот из программы PredPol

Дальнейшее развитие систем шло по пути делегирования им все большего числа административных функций. После 2012 года PredPol и обновленный по аналогии с ним Hunchlab стали помогать патрульным и с решением задачи коммивояжера: строили маршрут и затем отслеживали, не сбились ли с маршрута их «подопечные». Тогда же деятельность низовых полицейских стала оцениваться через PredPol.

Здесь же возникает одна из проблем подобных алгоритмов. Создать универсальные критерии для оценки работы сотрудников невозможно, и руководство вынуждено делать выбор. Hunchlab, например, предлагает четыре варианта формирования показателей:

- Полицейское управление самостоятельно определяет критерии;

- Оценка рассчитывается от материального ущерба преступления, обнаруженного полицейским;

- Критерии определяются на основе средней тяжести наказания в суде за тот или иной вид преступлений;

- Оценка формируется по результатам общественных обсуждений.

Каждый из этих пунктов, разумеется, не совершенен. Первый отдает приоритет административной (и подчас непрозрачной) логике. Второй сводит все к экономическому расчету и может пренебрегать фундаментальными принципами права. С третьим обратная ситуация: ориентируясь на наказание в суде за то или иное преступление, оценка сильно зависит от общего направления государственной уголовной политики или ее временных целей. Кроме того, ущерб от преступления может быть непропорционален наказанию, которое назначаются за него судом в принципе. Последний принцип, при котором критерии появляются благодаря публичным обсуждениям, подчиняет оценку крайне переменчивому мнению общества. Впрочем, схожие проблемы выбора критериев свойственны любой системе оценки по статистическим показателям.

Несмотря на эти контроверзы, PredPol и аналогичные системы быстро снискали популярность у правоохранительных органов США и других стран, благодаря заявлениям их создателей и исследованиям, которые подтверждали, что технология уменьшает количество преступлений. Например, авторы рандомизированного контролируемого эксперимента, проведенного в Лос-Анджелесе и Кенте (Великобритания), пришли к выводу, что модели предсказывают вдвое больше преступлений, чем эксперты-криминологи, а их использование снижает частоту некоторых преступлений аж на 7,4 процента. В этом смысле PredPol помогал полицейским в «горячих точках», лучше, чем практиковавшаяся до этого «человеческая» аналитика полицейских департаментов.

Сторонники PredPol подчеркивают и другие преимущества использования «умных» инструментов:

- они экономнее: точечное предсказание позволяет полиции точечно же и развертывать свои силы;

- они могут сгладить проблему расовой дискриминации: первоначально инструменты продвигались как по определению «слепые к цвету кожи», и потому выгодно отличающиеся от предвзятого полицейского на улице;

А главное – общее падение уровня преступности (которому способствуют, как считается, такие системы) повышает ощущение безопасности у граждан и, в конечном итоге, улучшает качество жизни.

Критика

Однако критики предиктивных систем показывают, что эта картина не столь безоблачна. Все статьи, подтверждающие эффективность PredPol, были выполнены или его разработчиками или аффилированными с организацией исследователями, что дает поводы для сравнения ситуации с той же опиоидной эпидемией в США и роли в ней фармкомпаний, спонсировавших исследования о безвредности лекарств наркотического типа. Помимо этого существуют и другие работы, авторы которых не находят значимого эффекта от новых полицейских технологий, однако они анализировали не PredPol, а другие, менее известные инструменты. Что приводит нас к другому критическому аргументу.

Из-за корпоративной тайны предсказательные алгоритмы становятся непрозрачными уже и для полицейских, которые их используют. Это делает независимую проверку эффективности систем, подобных PredPol, практически невозможной. Непрозрачность может быть также на руку руководителям полицейских отделений: манипулировать статистикой и заявлять о постоянном снижении преступности благодаря использованию алгоритмов (и легитимируя тем самым запросы на увеличение бюджета полицейских департаментов), становится проще.

Например, полиция Мемфиса отчитывалась, что система эффективна и сокращает преступность — однако позже обнаружилось, что правоприменители сравнивают показатели с годом установки системы, в который был неожиданный всплеск числа преступлений. Перепроверка данных в пятилетней динамике до анализируемого года показала, что реальные показатели устроены несколько сложнее, чем заявляли полицейские. Несмотря на то, что общее число преступлений действительно снизилась на 8 процентов — и неизвестно, какова в этом заслуга предиктивной аналитики, — насильственная преступность в городе выросла на 14 процентов.

Еще один аргумент против систем прогноза преступности – опасения в том, что обученный на исторических данных алгоритм унаследует у человеческой системы правоохранения известную предвзятость отношению к каким-то группам населения (в первую очередь к афроамериканцам в случае США). Такая предубежденность способна порождать петли обратной причинности (feedback loop). Это явление, когда изначально большее количество данных о каком-то районе (чаще всего с повышенным криминальным риском) приводит к назначению на его патрулирование большего числа полицейских — а это порождает всплеск криминальных событий в районе (потому что полицейским нужно выполнять отчетность), что замыкает круг. Профессор MIT Гэри Маркс описал механизм таких петель как «категорическую подозрительность» (categorical suspicion) – заведомо подозрительное отношение офицера ко всем жителям районов, которые были отмечены технологией как опасные.

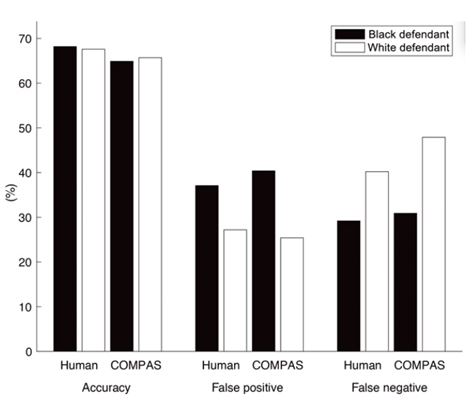

Схожие проблемы существуют и в person-based системах. Например, в одном из исследований 2018 года авторы сравнивали предсказания системы COMPAS с ответами пользователей одной из краудсорсинговых платформ на вопросы о том, совершит ли тот или иной заключенный преступление в будущем или нет. У неподготовленных людей было меньше данных, чем у алгоритма, но они, во-первых, смогли показать результаты сопоставимые с программой, а во-вторых — также проявили расовую предвзятость.

Accuracy — процент точно предсказанных рецидивов, False positive — процент ложноположительных предсказаний, False negative — процент ложноотрицательных предсказаний (рецидив случился, но он не был предсказан). Human — предсказания людей, COMPAS — предсказания программы. Белые столбики — «белые» подозреваемые. Черные столбики — подозреваемые афроамериканцы.

Проверка на предвзятость

Одну из самых известных демонстраций проблем с алгоритмами осуществили Кристиан Лам и Уильям Айзек, которые симулировали работу полиции после введения predictive policing в случае, если изначальные данные для системы «предвзяты» по отношению к афроамериканцам. Для симуляций использовались данные об арестах по наркотическим статьям в Окленде (Калифорния): наркоторговля там, как показывают качественные исследования и опросы, равномерно распределена по всему городу, однако аресты в связи с ней сконцентрированы в кварталах с афроамериканским населением.

Ученые постарались воспроизвести алгоритмы PredPol и посмотреть, как они будут предсказывать районы, где должны произойти наркопреступления в будущем — и получили перепредставленность небелых кварталов как неблагонадежных, причем алгоритм усилил полицейскую логику, рекомендуя полицейским посещать районы с афроамериканским населением в два раза чаще, чем другие.

Создатели PredPol постарались возразить на критику, одновременно признавая, что система не идеальна. Сначала они проанализировали результаты своего собственного эксперимента, в котором раз в день предоставляли полицейским данные о «горячих точках», подготовленные попеременно программой и экспертами-криминологами. После чего исследователи замеряли, отличается ли время, проведенное полицейскими за день в предсказанных hotspots, а также количество арестов при одном и другом сценарии. Они таким образом хотели показать, что алгоритм ничем не «хуже» людей — и действительно не обнаружили никакой значимой разницы. Тем не менее, это ничего не говорит о том, проецируют ли предиктивные системы расовую предвзятость людей, которых они призваны заменить, или нет.

Разработчики PredPol не отрицают ни расовой предвзятости полицейских, ни того, что она может оказывать существенное влияние на работу технологий. Один из соавторов программы Джефри Браттингем с помощью симуляций проверил, при каком проценте изначально искаженных данных (где проявилась предубежденность по отношению к представителям меньшинств) предсказания начнут значимо изменяться. В итоге он пришел к выводу, что пороговым значениям является 5 процентов. Вопрос, какова степень искажения реальных данных, все еще открыт.

Как повернется общественный консенсус по отношению к предиктивной аналитике, предсказать сложно: популярность у полицейских их не падает, а попыток выстроить более сбалансированную оценку действий полицейских и сам дизайн предсказательных технологий разработчики, естественно, не оставляют. Самими системами предиктивной аналитики интересуются все больше и за пределами США. Помимо Китая, известного экспериментами с алгоритмизацией госуправления, такие технологии уже применяются в Великобритании, Германии, Польше и многих других странах. Не так давно МВД России заказало исследование применимости систем машинного обучения для выявления серийности преступлений и правонарушений. Несмотря на то, что предиктивные технологии находятся в нашей стране на стадии становления, можно сказать о существовании общего (пусть и не столь сильного) тренда на их использование правоприменителями.

В завершении стоит отметить, что дискуссии о предиктивной аналитике в полиции часто упускают из внимания то, как сами полицейские воспринимают ее результаты и насколько она в принципе способна влиять на их решения. Ведь они могут, например, относиться к аналитике многомилионной по стоимости системы, как к прогнозу погоды — не очень надежному инструменту, производящему не критически важные сведения. Но это тема уже для отдельного исследования.